Vous ouvrez le relevé : un nombre total, parfois une note brute, un percentile, des sous-scores par domaine, et parfois une fourchette. En quelques secondes, la discussion part souvent dans la mauvaise direction : est-ce que ce score est bon ou mauvais ?

La bonne lecture commence ailleurs. La note brute dit ce que l’élève a réussi sur cette version précise du test. Le score étalonné, ou score mis à l’échelle, sert à comparer des performances entre différentes éditions ou sessions. Le percentile situe l’élève par rapport à un groupe de référence. Les sous-scores, eux, peuvent suggérer des points forts et des fragilités, mais ils ne valent presque jamais diagnostic à eux seuls.

Autrement dit, un relevé de score ne donne pas une seule réponse. Il en donne plusieurs, chacune utile pour une décision différente : comprendre le niveau atteint, comparer de façon un peu plus juste, situer l’élève dans une population, ou ajuster la préparation. Le vrai enjeu, pour les familles, est donc simple : savoir quel chiffre répond à quelle question avant de décider d’un nouveau test, d’un changement de méthode ou d’un objectif à revoir.

Ce que chaque ligne du relevé répond vraiment

Le même résultat peut afficher plusieurs chiffres sans contradiction. C’est normal : ils ne mesurent pas exactement la même chose. Le vocabulaire varie selon les organismes — score mis à l’échelle, score standardisé, catégories de contenu, domaines de compétence — mais la logique reste proche. Voici le réflexe le plus utile pour lire un relevé sans se tromper.

| Indicateur | Ce qu’il mesure | À quoi il sert | Le piège fréquent |

|---|---|---|---|

| Note brute | Le nombre de réponses correctes, ou parfois un total calculé selon les règles propres au test | Voir ce qui a été réussi sur cette version du test | La comparer directement à une autre session ou à un autre test |

| Score étalonné | Une performance convertie sur une échelle commune | Comparer plus justement des éditions, sessions ou formes de test différentes | Le traiter comme une note sur 20 ou un pourcentage |

| Percentile | La position relative par rapport à un groupe de référence | Situer l’élève parmi d’autres candidats ou testeurs | Le confondre avec un pourcentage de bonnes réponses |

| Sous-scores | Des résultats par domaine, compétence ou catégorie | Repérer des tendances de préparation | Leur donner plus de précision qu’ils n’en ont réellement |

Cette table change déjà beaucoup de choses. Un élève peut très bien avoir une note brute moyenne sur une forme difficile, obtenir un score étalonné correct, et se situer à un percentile élevé dans le groupe de référence. Ces chiffres ne se contredisent pas : ils répondent à des questions différentes.

Le piège le plus fréquent : le percentile n’est pas un pourcentage de bonnes réponses

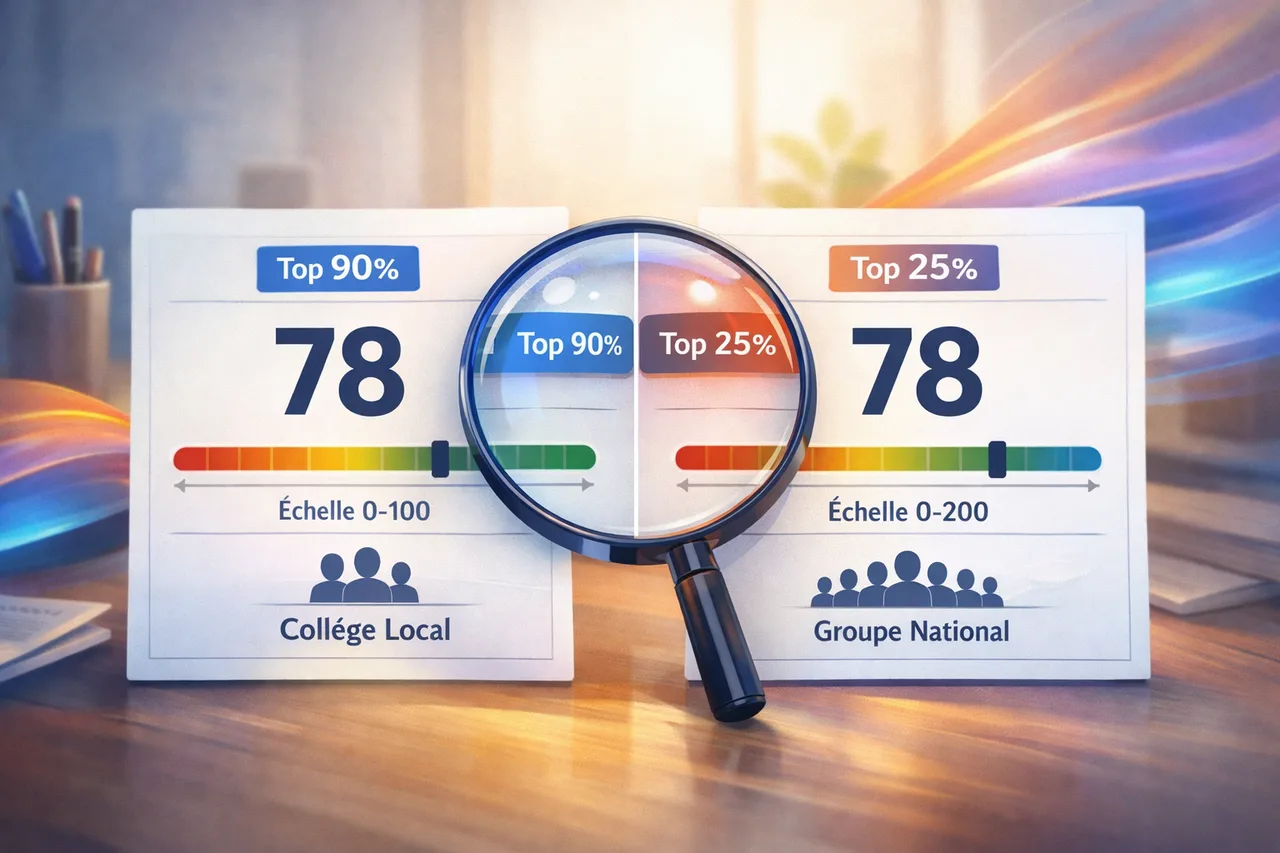

C’est l’erreur classique. Un 80e percentile ne signifie pas « 80 % de réponses justes ». Cela signifie que l’élève a fait aussi bien que, ou mieux que, environ 80 % du groupe de comparaison retenu pour ce rapport.

La différence est décisive. Le pourcentage de bonnes réponses parle de la copie. Le percentile parle de la position relative. On peut donc avoir un percentile élevé avec un pourcentage de bonnes réponses qui ne paraît pas spectaculaire, si le test est difficile ou si le groupe de référence a lui-même obtenu des scores plutôt bas. L’inverse existe aussi.

Dans la pratique, commencez toujours par repérer ce que regarde réellement l’établissement, le programme ou le concours visé : un score total, un score par section, un seuil minimal, un rang relatif, ou un ensemble plus large d’éléments du dossier. C’est cette information qui doit guider la lecture du relevé, pas le chiffre qui impressionne le plus au premier coup d’œil.

Les sous-scores sont des indices, pas un verdict

Les sous-scores attirent l’œil parce qu’ils semblent très précis. Lecture, algèbre, vocabulaire, résolution de problèmes, raisonnement scientifique, ou autre découpage selon le test : tout cela donne l’impression d’un diagnostic fin. Il faut pourtant rester prudent.

D’abord, un sous-score repose souvent sur moins d’items que le score total. Plus le domaine est étroit, plus un petit nombre de questions peut peser lourd. Ensuite, certains sous-scores sont de simples pourcentages de réussite dans une catégorie, alors que d’autres sont eux-mêmes mis à l’échelle. Enfin, les catégories du rapport ne sont pas toujours des compartiments purs : une même question peut mobiliser plusieurs compétences à la fois.

Les sous-scores deviennent vraiment utiles dans trois cas :

- quand une faiblesse revient de manière cohérente sur plusieurs tests ou plusieurs tests blancs ;

- quand elle correspond à des erreurs observées concrètement dans les copies ou les corrections ;

- quand elle permet de choisir une action précise de préparation, et pas seulement une inquiétude de plus.

Ils deviennent trompeurs quand on leur demande trop :

- interpréter un petit écart comme une vérité profonde sur le profil de l’élève ;

- conclure qu’un enfant est « faible » dans un domaine sur la base d’un seul rapport ;

- comparer directement des sous-scores provenant de tests différents, ou parfois de sessions différentes, sans vérifier s’ils sont réellement comparables ;

- bâtir tout un plan de travail sur une catégorie qui ne représente que très peu de questions.

Le bon usage d’un sous-score est donc modeste et pratique. Il sert à formuler une hypothèse de travail : faut-il revoir un domaine précis, retravailler le format des questions, ou surtout améliorer la gestion du temps et de l’attention ? Il ne suffit pas à conclure qu’un élève « n’a pas le niveau » dans une compétence entière.

Une autre règle protège bien les familles : ne changez pas toute la stratégie à partir d’un seul sous-score isolé. Cherchez un motif récurrent. Si la même faiblesse apparaît sur plusieurs relevés, dans les erreurs faites à la maison, et dans le ressenti de l’élève, alors elle devient un signal crédible. Sinon, elle reste une piste, pas une preuve.

Pourquoi comparer deux scores sans contexte peut tromper

Beaucoup de mauvaises décisions viennent d’une comparaison trop rapide. On regarde deux chiffres, on les classe du meilleur au moins bon, puis on conclut : progression, stagnation, chute, ou potentiel limité. En réalité, comparer deux scores sérieusement suppose de vérifier au moins trois choses : l’échelle, le groupe de référence et la marge d’incertitude.

Premier piège : la même note brute n’a pas toujours la même signification. Si deux versions d’un test n’ont pas exactement la même difficulté, la conversion en score étalonné existe justement pour éviter une comparaison naïve.

Deuxième piège : le même score n’a pas toujours le même percentile. Tout dépend du groupe utilisé pour établir ce rang : cohorte récente de testeurs, population plus large, niveau scolaire particulier, ou autre référence choisie par l’organisme. Un percentile n’a de sens qu’avec son groupe de comparaison.

Troisième piège : un petit écart n’est pas forcément un vrai changement. Certains relevés affichent une fourchette de score, une plage probable, ou une indication voisine. Quand c’est le cas, elle rappelle une réalité simple : un test n’est pas une mesure parfaite au millimètre. Une petite hausse ou une petite baisse ne justifie pas automatiquement un grand récit sur la progression ou l’échec.

Enfin, certains tests sont adaptatifs, et beaucoup de familles l’oublient. Dans ce cas, le chemin pris dans le test influence la difficulté des questions rencontrées ensuite, ce qui rend encore plus fragile une lecture fondée sur le seul « nombre de bonnes réponses ».

Prenons un exemple fictif. Un élève obtient un score légèrement inférieur à son test blanc précédent, mais son percentile reste proche, son sous-score faible n’apparaît plus au même endroit, et la fourchette du rapport se recouvre largement. La conclusion raisonnable n’est pas « il régresse ». C’est plutôt : le signal est trop faible pour affirmer une baisse nette, donc il faut regarder la tendance sur plusieurs essais et les erreurs concrètes, pas dramatiser un seul écart.

L’inverse est vrai aussi. Un percentile élevé peut rassurer à tort dans un contexte très sélectif, si le programme visé regarde surtout un score de section, un seuil précis, ou un bassin de candidats plus fort que la population de référence du rapport. Le chiffre est bon en lui-même, mais il ne répond pas forcément à la bonne question.

Les questions utiles avant de décider de la suite

Avant de conclure qu’il faut refaire le test, changer totalement de méthode ou investir davantage dans la préparation, posez quelques questions simples. Elles évitent une grande partie des décisions prises sous stress.

Quelle mesure compte réellement pour l’objectif visé ?

Certains contextes regardent surtout le score total. D’autres accordent plus de poids à une section, à un seuil minimal, à un score de référence, ou à l’ensemble du dossier. Tant que cette règle n’est pas claire, on peut surinterpréter le mauvais indicateur.À quel groupe le percentile compare-t-il l’élève ?

Population générale, testeurs récents, niveau scolaire donné, candidats d’une zone donnée : le mot percentile reste le même, mais la comparaison change.L’écart observé est-il plus grand que la variation normale du test ?

Si le rapport mentionne une fourchette, une plage ou une estimation voisine, servez-vous-en. Sinon, évitez déjà d’interpréter un petit mouvement comme une vérité solide.Le problème est-il global ou concentré ?

Un score total faible avec des sous-scores assez homogènes n’appelle pas la même réponse qu’un score total correct avec une faiblesse récurrente dans un seul domaine.Le motif se répète-t-il sur plusieurs essais ?

Une tendance stable mérite une action. Un point isolé mérite d’être vérifié avant de réorganiser tout le travail.Quelle action concrète découle du relevé ?

Revoir une compétence précise, travailler le temps, changer le format d’entraînement, viser un autre calendrier, ou au contraire arrêter d’empiler les tests blancs : un bon relevé débouche sur une décision pratique. Si aucune action claire n’en sort, c’est souvent qu’on n’a pas encore assez bien interprété le résultat.

Cette série de questions a un effet utile : elle ramène la discussion familiale du jugement vers l’ajustement. On cesse de demander « est-ce que mon enfant vaut ce score ? » pour demander « qu’est-ce que ce relevé autorise raisonnablement à conclure, et que doit-on faire ensuite ? »

Le bon ordre de lecture en une minute

Quand vous recevez un relevé de score, l’ordre de lecture compte presque autant que le contenu. Voici un réflexe simple, plus fiable que l’impression du premier chiffre vu.

- Repérez la mesure décisionnelle : score total, section, seuil, score de référence, ou autre critère réellement utilisé.

- Lisez ensuite le percentile avec son groupe de référence, jamais seul.

- Traitez les sous-scores comme des hypothèses de travail, surtout s’ils reposent sur peu d’items ou n’apparaissent qu’une fois.

- Ne comparez que ce qui est comparable : même test, même échelle, même type de rapport, et si possible plusieurs résultats plutôt qu’un seul.

- Décidez enfin d’une suite concrète : consolider, cibler un domaine, refaire un test plus tard, ou renoncer à une comparaison trompeuse.

Un relevé bien lu ne sert pas seulement à savoir si le résultat paraît bon. Il sert à distinguer ce qu’on peut vraiment comparer, ce qu’on peut seulement soupçonner, et ce qu’il serait prématuré de conclure. C’est cette discipline-là qui évite les faux espoirs, les décisions hâtives et les révisions mal ciblées.